“En pleine production”. Une nouvelle fois, Jensen Huang se veut rassurant. Et promet que les livraisons de Blackwell, la prochaine génération de carte graphique de Nvidia dédiée à l’intelligence artificielle générative, commenceront bien au quatrième trimestre. Il y a quelques jours pourtant, le site The Information faisait état d’un problème de surchauffe, qui avait laissé craindre des délais supplémentaires. Et qui avait inquiété les investisseurs de Wall Street, alors que le groupe de Santa Clara est devenu la première capitalisation boursière mondiale. La demande pour Blackwell est “incroyable”, assure son patron, en marge de résultats trimestriels en très forte hausse. Entre août et octobre, le chiffre d’affaires a presque doublé, à 35 milliards de dollars. Et les profits ont dépassé la barre des 19 milliards.

Doutes sur la demande – Depuis le printemps 2023, Nvidia enregistre une hausse vertigineuse de son activité. Dans le sillage du lancement de ChatGPT, une véritable course à l’armement a lieu pour bâtir des capacités de calculs informatiques. Les géants technologiques dépensent ainsi sans compter pour mettre la main sur ses GPU, utilisés pour entraîner et faire tourner les derniers modèles d’IA générative. Sur un secteur en pleine effervescence, la société dispose d’une avance technologique considérable sur ses concurrents. Elle occupe donc une position quasiment monopolistique. Ces derniers mois, des doutes ont commencé à émerger sur la croissance à venir, alors que l’IA tarde à s’imposer dans les entreprises, notamment en raison de ses coûts élevés. De fait, Nvidia anticipe des ventes en hausse de “seulement” 70% sur le trimestre en cours.

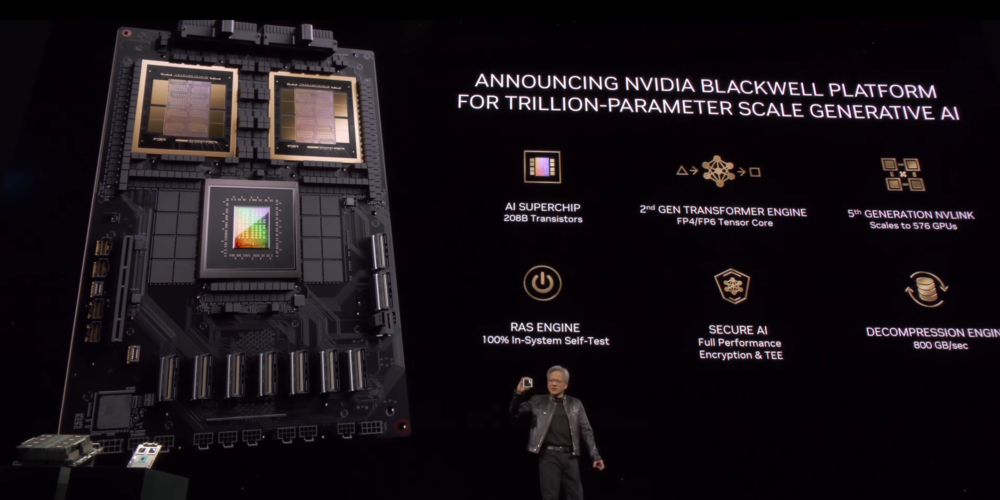

Modèles plus gros – Jensen Huang rétorque que le cycle d’investissement ne fait que commencer, alors que les besoins en puissance de calcul sont “exponentiels”. Pour y répondre, il a présenté en mars, devant plus de 9.000 personnes, une nouvelle architecture de puces. Baptisée Blackwell, en hommage à un mathématicien américain, celle-ci affiche des performances bien supérieures à l’architecture Hopper, sur laquelle sont bâtis ses GPU H100 et H200, les références actuelles du secteur. Selon Nvidia, elle doit permettre d’entraîner des modèles comptant jusqu’à 10.000 milliards de paramètres, cinq fois plus que le plus gros modèle actuel d’OpenAI. La société met aussi en avant des gains de temps, tant pour l’entraînement que pour l’inférence (le processus de génération de textes ou d’images). Et d’importantes économies d’énergie.

Rythme d’innovation – Depuis, ce nouveau GPU a rencontré plusieurs difficultés de conception, décalant la commercialisation de plusieurs mois. Mais le problème de surchauffe aurait déjà été réglé, estiment les analystes de Semianalysis. Le principal défi pour Nvidia est désormais d’augmenter les cadences de production, avec le fondeur taïwanais TSMC. Jeudi, son directeur financier a d’ailleurs prévenu que l’intégralité de la demande ne pourra pas être satisfaite pendant “plusieurs trimestres”. Le lancement de Blackwell est capital. Non seulement pour maintenir une croissance élevée, mais aussi pour conserver une nette avance sur ses rivaux, en particulier AMD qui a réalisé d’importants progrès. Pour la suite, Jensen Huang promet de doubler le rythme d’innovation, en sortant un nouveau modèle par an, au lieu de tous les deux ans.

Pour aller plus loin:

– Après l’euphorie, les craintes d’une bulle autour de l’IA générative

– OpenAI s’allie à Broadcom pour concevoir ses propres puces d’IA