Il y a six mois, en officialisant l’éviction abrupte et inattendue de Sam Altman, réinstallé à son poste à peine cinq jours plus tard, le conseil d’administration d’OpenAI reprochait au dirigeant de ne pas avoir été “toujours honnête”. Ses critiques les plus fervents l’accusaient alors d’être “manipulateur et fourbe”, selon des propos rapportés par le New Yorker. Et aussi de ne pas en faire suffisamment, malgré les discours de façade, pour chercher à comprendre et à limiter les risques liés aux progrès exponentiels de l’intelligence artificielle. L’histoire semble désormais leur donner raison. Ces dernières semaines, plusieurs polémiques ont en effet apporté un éclairage parlant sur la face cachée du concepteur de ChatGPT et de son charismatique patron, désormais débarrassé de toute voix discordante au sommet de la start-up.

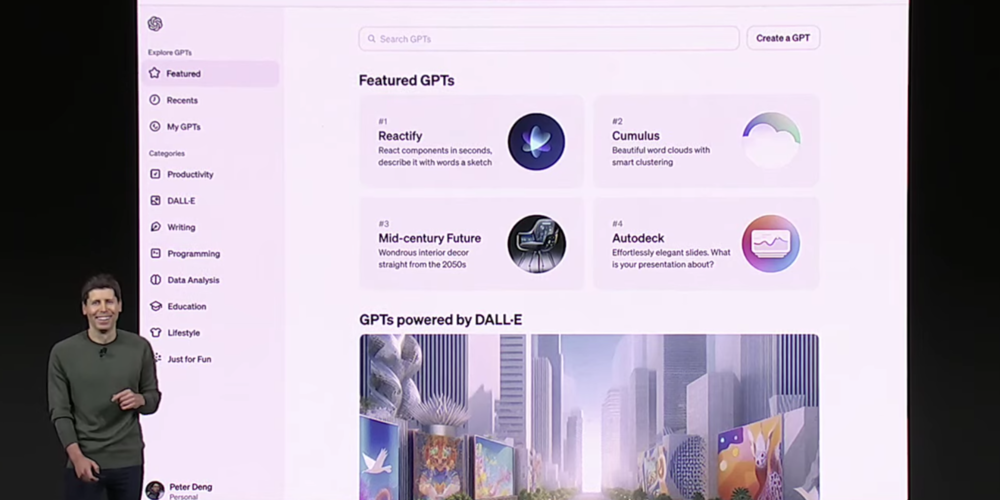

Équipe dissoute – Exit notamment Ilya Sutskever, le directeur scientifique qui incarnait une approche plus prudente du développement de l’IA. Il a démissionné mi-mai, quelques jours à peine après la présentation d’un nouveau modèle, baptisé GPT-4o, aux fonctionnalités décuplées. Dans la foulée, l’équipe de “superalignement”, qu’il codirigeait, a été démantelée par OpenAI. Celle-ci avait été lancée à l’été 2023 pour s’assurer que la technologie reste sous contrôle, avec la promesse de pouvoir utiliser 20% de la puissance de calcul détenue par la start-up. Une promesse qui n’a pas été tenue. “Il devenait de plus en plus difficile de mener nos recherches”, assure ainsi Jan Leike, le deuxième patron de l’équipe, lui aussi démissionnaire. Et d’affirmer que “la sécurité a été reléguée au second plan au profit de nouveaux produits”.

“Non-dénigrement” – Au moins trois autres responsables de la sécurité ont quitté l’entreprise. Face à cette vague de départs, Sam Altman a promis d’en faire plus dans le domaine. Un double discours qui rappelle celui sur la régulation. Dans sa quête vers une IA générale, capable d’apprendre et de réaliser n’importe quelle tâche, le patron d’OpenAI ne semble plus vouloir s’embarrasser des discours contestataires. Une volonté également illustrée par les informations du site Vox, qui a révélé que la société a fait signer des clauses de “non-dénigrement” à ses anciens employés, leur interdisant toute critique sous peine de perdre ou de ne pas pouvoir revendre les actions gratuites qui faisaient partie de leur rémunération. Une pratique inhabituelle que Sam Altman assure avoir juste découverte et annulée immédiatement.

Voix imitée ? – Autre polémique: la voix utilisée dans la présentation de GPT-4o. L’actrice Scarlett Johansson estime qu’elle est “étrangement similaire” à la sienne. Elle menace désormais d’attaquer la start-up en justice, indiquant qu’elle avait refusé de prêter sa voix pour faire parler le modèle. OpenAI dément avoir tenté de l’imiter, assurant avoir embauché une actrice plusieurs mois avant d’avoir contactée la star. Un argument mis à mal par le message “her” posté par Sam Altman, en référence au film du même nom dans lequel Scarlett Johansson incarne une IA. Les précédents de la start-up ne plaident pas en sa faveur. Elle aurait utilisé deux bases de données, depuis effacées, contenant des centaines de milliers de livres pour entraîner son modèle GPT. Ou encore des vidéos YouTube pour son outil de création de vidéos Sora.

Pour aller plus loin:

– OpenAI abandonne le développement de son dernier modèle de langage

– Le double discours d’OpenAI sur la régulation de l’IA